FYI.

This story is over 5 years old.

Perché Eugene Goostman non ha superato il test di Turing

Il risultato raggiunto dal software Eugene Goostman è sicuramente significativo, ma superare il test di Turing è un'altra cosa.

Il test di Turing

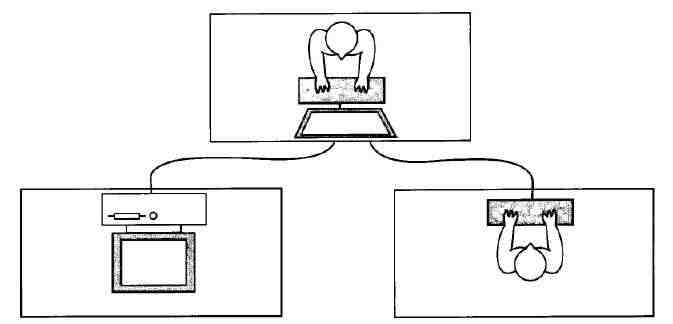

Quello che ha sostenuto Turing è che intorno al 2000 sarebbe stato possibile per i programmi di computer giocare così bene al gioco dell’imitazione che l’interrogatore non avrà più del 70 percento di possibilità di compiere la corretta identificazione dopo 5 minuti di conversazione.

Ora, prima di parlare delle differenze tra il gioco dell’imitazione e il compito a cui è stato sottoposto Eugene, vale la pena ricordare un aspetto estremamente importante. Il gioco dell’imitazione, sin da quando è stato proposto, ha provocato diverse obiezioni che si dividono in questioni empiriche—i computer saranno in grado di giocare così bene al gioco dell’imitazione in modo che un interrogatore non superi la media del 70 percento di identificazioni corrette? —e concettuali—se fosse vero che un interrogatore non può superare il 70 percento di corrette identificazioni dobbiamo concludere che le macchine esibiscono o possiedono un livello di pensiero, o sono intelligenti o possiedono una mentalità?

Non è il caso di entrare nel dettaglio di queste critiche (una esaustiva trattazione compilativa delle critiche può essere trovata qui), ci basta semplicemente fare un paragone tra il gioco dell’imitazione, il test a cui è stato sottoposto Eugene e cosa sosteneva Turing per contestualizzare più adeguatamente il risultato conquistato da Eugene.

Eugene Goostman è un sofisticato cleverbot—un programma in grado di sostenere delle conversazioni in stile chatroom—che impersona un adolescente ucraino di 13 anni. È in grado di imitare il linguaggio di un adolescente (utilizzando locuzioni colloquiali) e imitarne gli atteggiamenti. Parlando con i giudici per 5 minuti, Eugene è riuscito a convincere il 33 percento dei giudici che fosse un ragazzo ucraino di 13 anni.

Il test di Turing

Quello che ha sostenuto Turing è che intorno al 2000 sarebbe stato possibile per i programmi di computer giocare così bene al gioco dell’imitazione che l’interrogatore non avrà più del 70 percento di possibilità di compiere la corretta identificazione dopo 5 minuti di conversazione.

Ora, prima di parlare delle differenze tra il gioco dell’imitazione e il compito a cui è stato sottoposto Eugene, vale la pena ricordare un aspetto estremamente importante. Il gioco dell’imitazione, sin da quando è stato proposto, ha provocato diverse obiezioni che si dividono in questioni empiriche—i computer saranno in grado di giocare così bene al gioco dell’imitazione in modo che un interrogatore non superi la media del 70 percento di identificazioni corrette? —e concettuali—se fosse vero che un interrogatore non può superare il 70 percento di corrette identificazioni dobbiamo concludere che le macchine esibiscono o possiedono un livello di pensiero, o sono intelligenti o possiedono una mentalità?

Non è il caso di entrare nel dettaglio di queste critiche (una esaustiva trattazione compilativa delle critiche può essere trovata qui), ci basta semplicemente fare un paragone tra il gioco dell’imitazione, il test a cui è stato sottoposto Eugene e cosa sosteneva Turing per contestualizzare più adeguatamente il risultato conquistato da Eugene.

Eugene Goostman è un sofisticato cleverbot—un programma in grado di sostenere delle conversazioni in stile chatroom—che impersona un adolescente ucraino di 13 anni. È in grado di imitare il linguaggio di un adolescente (utilizzando locuzioni colloquiali) e imitarne gli atteggiamenti. Parlando con i giudici per 5 minuti, Eugene è riuscito a convincere il 33 percento dei giudici che fosse un ragazzo ucraino di 13 anni.

È plausibile sostenere che il fatto che il personaggio interpretato da Eugene non fosse un madrelingua inglese come i suoi giudici abbia in qualche modo distorto il risultato, ma possiamo assumere lo stesso che sia una questione irrilevante (anche se intuitivamente non lo è affatto).

Così, quella raggiunta da Eugene è sicuramente una percentuale significativa. Seppure di poco ha superato la soglia indicata da Turing—che tuttavia non significa superare il test di Turing, ma bensì aver “fatto bene” al gioco dell’imitazione. Qui risiede l’errore nell’affermare con troppo entusiasmo che il test di Turing è stato superato.

Infatti, superare il test di Turing significa incontrare anche l’altra asserzione fatta da Alan Turing nello stesso articolo del 1950: “Credo che alla fine del secolo l'uso delle parole e l'opinione delle persone di cultura saranno cambiate a tal punto che si potrà parlare di macchine pensanti senza aspettarsi di essere contraddetti.”

È questa stessa asserzione che ha provocato la maggior parte delle obiezioni e delle critiche rivolte alla dimensione concettuale della sua proposta. Come è stato mostrato dalla ricerca filosofica e dalle innovazioni tecnologiche successive alla proposta di Turing, sembrerebbe ragionevole pensare che siamo ancora distanti dal poter “parlare di macchine pensanti senza aspettarsi di essere contraddetti.”

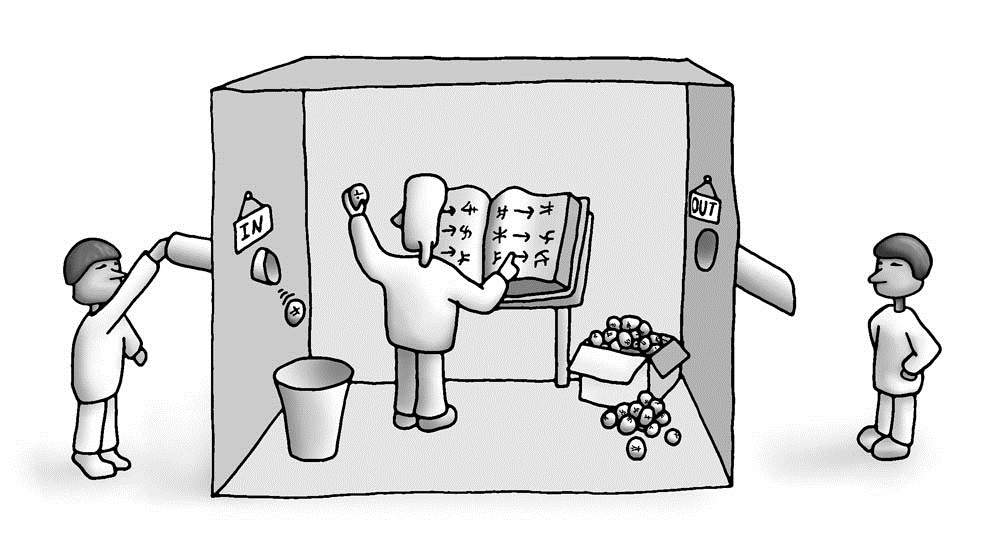

C’è anche chi, come il filosofo John Searle, ha mostrato attraverso un esperimento mentale simile a quello proposto da Turing che un programma può sembrare che comprenda un linguaggio, ma non che lo comprende realmente. Nell’esperimento, conosciuto come Argomento della Stanza Cinese, si immagina una persona del tutto ignorante della lingua cinese che chiusa all’interno di una stanza riceve dall’esterno dei fogli con delle domande in cinese, e seguendo un libro di istruzioni (un programma) riesce a spedire all’esterno dei fogli che a sua insaputa non sono altro che le corrette risposte in cinese alle domande che ha ricevuto.

È plausibile sostenere che il fatto che il personaggio interpretato da Eugene non fosse un madrelingua inglese come i suoi giudici abbia in qualche modo distorto il risultato, ma possiamo assumere lo stesso che sia una questione irrilevante (anche se intuitivamente non lo è affatto).

Così, quella raggiunta da Eugene è sicuramente una percentuale significativa. Seppure di poco ha superato la soglia indicata da Turing—che tuttavia non significa superare il test di Turing, ma bensì aver “fatto bene” al gioco dell’imitazione. Qui risiede l’errore nell’affermare con troppo entusiasmo che il test di Turing è stato superato.

Infatti, superare il test di Turing significa incontrare anche l’altra asserzione fatta da Alan Turing nello stesso articolo del 1950: “Credo che alla fine del secolo l'uso delle parole e l'opinione delle persone di cultura saranno cambiate a tal punto che si potrà parlare di macchine pensanti senza aspettarsi di essere contraddetti.”

È questa stessa asserzione che ha provocato la maggior parte delle obiezioni e delle critiche rivolte alla dimensione concettuale della sua proposta. Come è stato mostrato dalla ricerca filosofica e dalle innovazioni tecnologiche successive alla proposta di Turing, sembrerebbe ragionevole pensare che siamo ancora distanti dal poter “parlare di macchine pensanti senza aspettarsi di essere contraddetti.”

C’è anche chi, come il filosofo John Searle, ha mostrato attraverso un esperimento mentale simile a quello proposto da Turing che un programma può sembrare che comprenda un linguaggio, ma non che lo comprende realmente. Nell’esperimento, conosciuto come Argomento della Stanza Cinese, si immagina una persona del tutto ignorante della lingua cinese che chiusa all’interno di una stanza riceve dall’esterno dei fogli con delle domande in cinese, e seguendo un libro di istruzioni (un programma) riesce a spedire all’esterno dei fogli che a sua insaputa non sono altro che le corrette risposte in cinese alle domande che ha ricevuto.