Zrzut z ekranu z SendVids

Artykuł pierwotnie ukazał się na MOTHERBOARDPo sieci krąży film, w którym Gal Gadot uprawia seks ze swoim przyrodnim bratem. Tak naprawdę nie jest to jednak jej ciało, a jedynie twarz – i też nie do końca. To fotomontaż polegający na podmienieniu twarzy dwóch kobiet, w tym wypadku Gadot i aktorki grającej w kazirodczym porno.Wideo zostało opracowane za pomocą algorytmu uczenia maszynowego. Jego twórca wykorzystał powszechnie dostępne materiały i oprogramowania open-source, czyli takie, których nie ogranicza żadna licencja. Jest to coś, czego mógł dokonać każdy, kto posiada praktyczną wiedzę z zakresu uczenia maszynowego i tworzonych w ramach tej dziedziny algorytmów.Oczywiście ten fotomontaż na dłuższą metę nikogo nie oszuka. Czasami twarz Gadot się „zawiesza”, a do tego u widza pojawia się efekt doliny niesamowitości, czyli osobliwe poczucie dyskomfortu. Jednak na pierwszy rzut oka film wydaje się w miarę wiarygodny. Robi to o tyle duże wrażenie, że podobno stanowi on dzieło zaledwie jednej osoby, użytkownika Reddita funkcjonującego pod pseudonimem „deepfakes”. Nad powstaniem tego filmiku nie pracował cały zespół doświadczonych grafików, tak jak było to chociażby w przypadku Rogue One , gdzie za pomocą CGI odtworzono młodą księżniczkę Leię – deepfakes wykorzystał oprogramowania ściągnięte z sieci. Używał programów typu open-source, takich jak na przykład TensorFlow, które Google bezpłatnie udostępnia badaczom, uczestnikom studiów podyplomowych i wszystkim, którzy interesują się uczeniem maszynowym.Fragment filmiku zamieszczonego na SendVids, który przedstawia twarz Gal Gadot na ciele gwiazdy pornoIstnieje już narzędzie Adobe, które po 20 minutach nagrań potrafi naśladować głos dowolnego człowieka, oraz algorytm Face2Face umożliwiający podmienianie twarzy na filmie w czasie rzeczywistym. Ten nowy typ „sfałszowanej” pornografii pokazuje, że wkrótce będziemy żyć w świecie, w którym sfabrykowanie wiarygodnych filmów stanie się banalnie łatwe. Będą przedstawiały nieprawdziwe sytuacje, w tym realnie istniejących ludzi mówiących i robiących rzeczy, które tak naprawdę nigdy nie miały miejsca – w tym również sceny pornograficzne.Do tej pory deepfakes opublikował na Reddicie hardcorowe filmy porno z udziałem Scarlett Johansson, Maisie Williams, Taylor Swift, Aubrey Plazy i Gal Gadot. Napisałam do agentów reprezentujących każdą z tych aktorek i poinformowałam ich o istnieniu fałszywych filmów. Na razie nie otrzymałam żadnej odpowiedzi.Praktyka wklejania twarzy znanych kobiet na zdjęcia pornograficzne nie jest niczym nowym – ta kategoria porno od lat ma zagorzałych miłośników. Ludzie komentujący i głosujący na stronie na Reddicie z postami deepfakes są wielkimi fanami jego pracy.Według deepfakes, który odmówił ujawnienia swojej tożsamości, jego oprogramowanie zostało stworzone na podstawie wielu bibliotek open-source, takich jak Keras czy TensorFlow. Aby skompilować komputerowo twarze celebrytek, deepfakes użył jedynie wyszukiwarki obrazów Google, zdjęć stockowych i filmów z YouTube’a. Głębokie uczenie, czyli deep learning (podkategoria uczenia maszynowego zajmująca się doskonaleniem technik rozpoznawania głosu, obrazów czy języka) polega na tworzeniu sieci neuronowych, które samodzielnie wykonują obliczenia na danych wejściowych. W tym przypadku deepfakes dostosował algorytm do filmów porno i twarzy Gal Gadot. Po wystarczającej ilości „treningu” oprogramowanie samodzielnie zaczęło reorganizować połączenia – i tym samym tworzyć przekonujące filmy.Alex Champandard, badacz sztucznej inteligencji napisał mi w mailu, że przy dobrej konsumenckiej karcie graficznej można uzyskać ten efekt w ciągu zaledwie kilku godzin. Da się to również zrobić przy pomocy zwykłego procesora, przy czym będzie to trwało kilka dni.„W dzisiejszych czasach nie wymaga to już zaawansowanej technologii” – powiedział.Łatwość, z jaką ktoś mógłby to zrobić, budzi przerażenie. Oprócz pewnych umiejętności technicznych, do stworzenia takiego fałszywego filmu potrzebna jest jedynie wystarczająca liczba zdjęć czyjeś twarzy. A przecież wielu z nas dobrowolnie zamieszcza w sieci ich olbrzymie zbiory – w latach 2015-16 ludzie na całym świecie udostępnili ponad 24 miliardów selfie. Nietrudno wyobrazić sobie programistę-amatora, który wykorzystuje taki algorytm do stworzenia filmu erotycznego z kimś, kogo chce nękać.

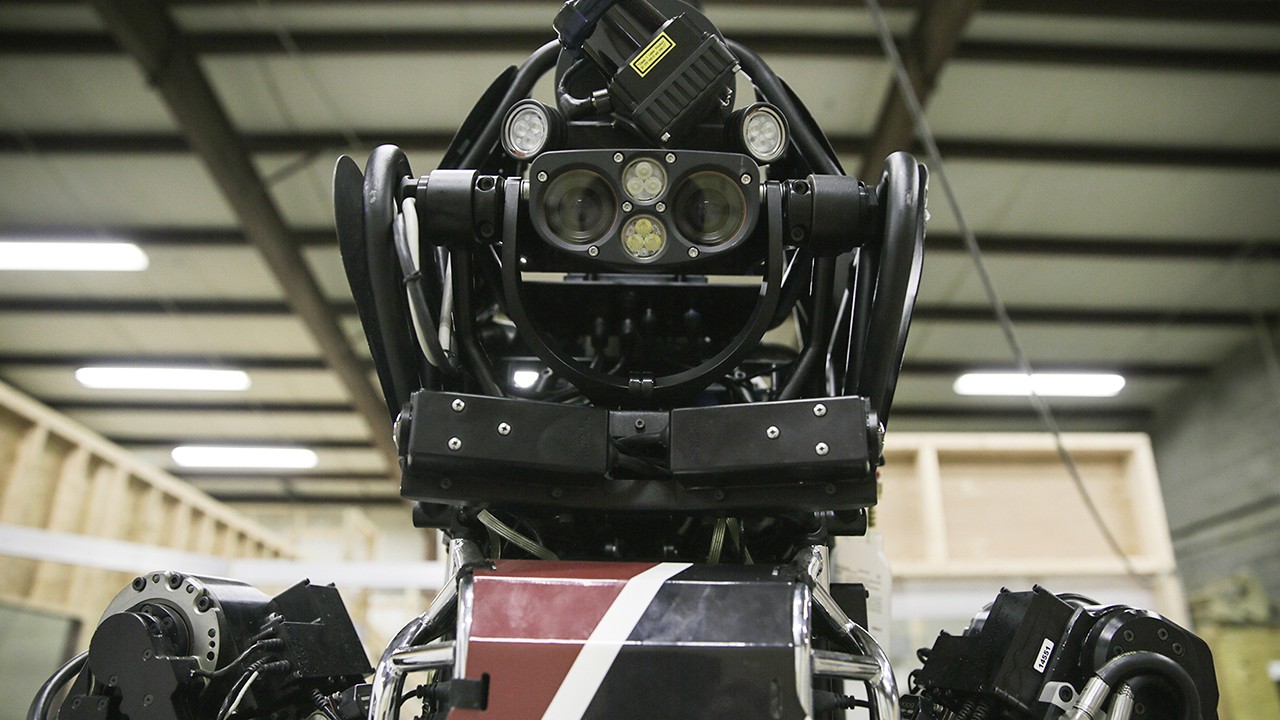

OBEJRZYJ: Nadchodzą zabójcze roboty

Deepfakes powiedział mi, że nie jest zawodowcem, tylko programistą zainteresowanym uczeniem maszynowym.„Po prostu znalazłem sprytny sposób na zamianę twarzy” – powiedział, nawiązując do swojego algorytmu. „Dzięki setkom obrazów twarzy z łatwością mogę wygenerować miliony zniekształconych obrazów, których potem używam, aby wytrenować sieć” – wyjaśnił. „Później, kiedy zamieszczam w tej sieci twarz innej osoby, uznaje ją ona za zniekształcony obraz i próbuje tak ją zmodyfikować, aby przypominała podobiznę, na której trenowała”.W komentarzach na Reddicie deepfakes wspomniał, że korzysta z algorytmu podobnego do tego, który opracowali pracownicy Nvidii. Ci drudzy używają głębokiego uczenia, aby np. przekształcić nagranie przedstawiające zimowy krajobraz w taki, który pokazuje lato – i to w czasie rzeczywistym. Badacze Nvidii, którzy opracowali algorytm, odmówili skomentowania takiego użycia ich wynalazku.Jednak prawie wszystkie filmy opublikowane przez deepfakes mają pewne wady. W wideo z Gadot od czasu do czasu wokół jej twarzy pojawia się pole, na którym widać oryginalny obraz. Do tego jej usta i oczy nie zawsze pasują do słów, które wypowiada aktorka. Ale jeśli trochę zmrużyć oczy, rzeczywiście wygląda to jak film z Gadot – a inne nagrania, które zrobił deepfake, są jeszcze bardziej przekonujące.Aktorka porno Grace Evangeline powiedziała mi na Twitterze, iż gwiazdy porno zdążyły się już przyzwyczaić do tego, że ich filmy są rozpowszechniane na darmowych portalach. Jednak przyznała, że ten przypadek to coś zupełnie innego i nigdy nie widziała czegoś podobnego.„W każdej sytuacji najważniejsza jest czyjaś zgoda” – podkreśliła Evangeline. „Zarówno w życiu prywatnym, jak i w takich produkcjach. Tworzenie fałszywych scen erotycznych ze sławnymi osobami odbywa się bez ich zgody. To moralnie naganne zachowanie”.

Widać więc, że nawet dla osób, które zarabiają na życie, występując nago przed kamerą, takie naruszenie cudzej prywatności i przekroczenie pewnych granic jest niepokojące. Filmik z Gadot pokazałam również Ali Janine, byłej aktorce porno, która przez 15 lat pracowała w branży pornograficznej. „To naprawdę godne potępienia” – powiedziała mi przez telefon. „Pokazuje to, że niektórzy mężczyźni postrzegają kobiety jako obiekty, którymi mogą manipulować i zmuszać do zrobienia czegokolwiek, co tylko chcą. To wyraz kompletnego braku szacunku nie tylko dla kobiet występujących w porno, ale i dla tych aktorek”.Zapytałam deepfakes, czy zastanawiał się nad etycznymi implikacjami tej technologii. Czy opracowując ten algorytm, pomyślał w ogóle o tym, że ktoś może nie wyrażać zgody na wykorzystywanie swojej twarzy? Czy nie obawiał się, że stanie się to narzędziem, za pomocą którego ludzie będą szantażować innych lub się na nich mścić?„Każda technologia może być wykorzystywana w złych celach i nie sposób tego powstrzymać” – odpowiedział, porównując swój algorytm do tej samej technologii, dzięki której Paul Walker pośmiertnie „wystąpił” w Szybkich i wściekłych 7 . „Główna różnica polega na tym, że teraz może to zrobić praktycznie każda osoba. Nie wydaje mi się, żeby było coś złego w tym, że przeciętni ludzie zaczynają się interesować uczeniem maszynowym”.Z etycznego punktu widzenia konsekwencje są „olbrzymie” – powiedział Champandard. Złośliwego użycia technologii zazwyczaj nie udaje się uniknąć, ale można z nim walczyć.„Koniecznie należy przeprowadzić na ten temat bardzo głośną debatę publiczną” – wyjaśnił. „Każdy musi wiedzieć, jak łatwo jest sfałszować obrazy i filmy, oraz że już za kilka miesięcy nie będziemy w stanie odróżnić fałszywek od prawdziwych obrazów. Oczywiście technologia ta istniała już od dłuższego czasu, ale wcześniej stworzenie takiego filmu wymagało dużej ilości pieniędzy i zatrudnienia specjalistów od efektów wizualnych. Teraz może zrobić to każdy programista, który ma dobry komputer”.Champandard stwierdził, że warto byłoby zacząć od stworzenia technologii, które umożliwiłyby wykrywanie fałszywych filmów. Następnie należałoby wprowadzić przepisy lub zmienić politykę serwisów internetowych w taki sposób, aby wypracować pewien wzór postępowania w sytuacjach, kiedy ktoś upubliczni podobne nagrania – szczególnie jeśli zrobi to w ramach nękania.„Aby poradzić sobie z taką sytuacją, musimy skoncentrować się na uświadamianiu i edukacji społeczeństwa” – skwitował Champandard.

Więcej na VICE:

Reklama

Reklama

Reklama

OBEJRZYJ: Nadchodzą zabójcze roboty

Deepfakes powiedział mi, że nie jest zawodowcem, tylko programistą zainteresowanym uczeniem maszynowym.„Po prostu znalazłem sprytny sposób na zamianę twarzy” – powiedział, nawiązując do swojego algorytmu. „Dzięki setkom obrazów twarzy z łatwością mogę wygenerować miliony zniekształconych obrazów, których potem używam, aby wytrenować sieć” – wyjaśnił. „Później, kiedy zamieszczam w tej sieci twarz innej osoby, uznaje ją ona za zniekształcony obraz i próbuje tak ją zmodyfikować, aby przypominała podobiznę, na której trenowała”.W komentarzach na Reddicie deepfakes wspomniał, że korzysta z algorytmu podobnego do tego, który opracowali pracownicy Nvidii. Ci drudzy używają głębokiego uczenia, aby np. przekształcić nagranie przedstawiające zimowy krajobraz w taki, który pokazuje lato – i to w czasie rzeczywistym. Badacze Nvidii, którzy opracowali algorytm, odmówili skomentowania takiego użycia ich wynalazku.

Reklama

Polub fanpage VICE Polska i bądź z nami na bieżąco

Widać więc, że nawet dla osób, które zarabiają na życie, występując nago przed kamerą, takie naruszenie cudzej prywatności i przekroczenie pewnych granic jest niepokojące. Filmik z Gadot pokazałam również Ali Janine, byłej aktorce porno, która przez 15 lat pracowała w branży pornograficznej. „To naprawdę godne potępienia” – powiedziała mi przez telefon. „Pokazuje to, że niektórzy mężczyźni postrzegają kobiety jako obiekty, którymi mogą manipulować i zmuszać do zrobienia czegokolwiek, co tylko chcą. To wyraz kompletnego braku szacunku nie tylko dla kobiet występujących w porno, ale i dla tych aktorek”.

Reklama

Reklama

Więcej na VICE: