Fotografija via Fried et. al

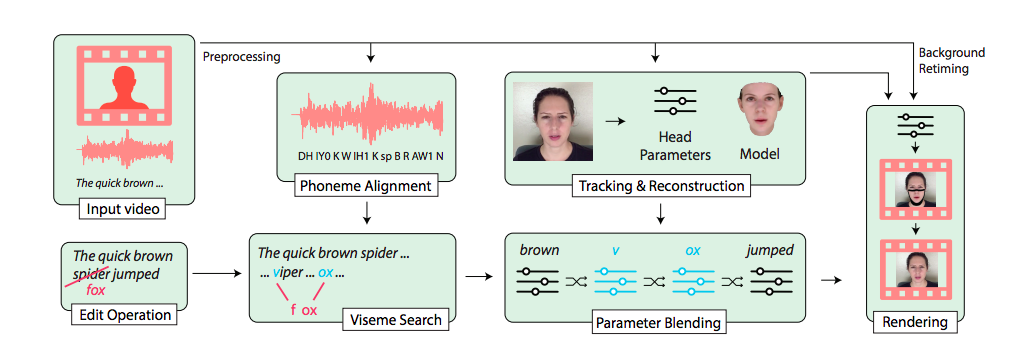

Tim istraživača sačinjen od eksperata za mašinsko učenje sa Stenford i Prinston Univerziteta, kao i sa Instituta za informatiku Maks Plank, ali i iz kompanije Adobe, stvorili su metod koji bukvalno ljudima stavlja reči u usta, koristeći tekstualni input i izvorni video.Analizom šablona po kojima ljudi pričaju u videima gde jedna osoba govori u kameru, oni su uspeli da zamene čitave fraze drugim, u potpunosti drugačijim frazama. A razultati su poprilično realistični.Njihov projekat, "Text-based Editing of Talking-head Video," objavljen je na Internetu ove nedelje, dok će tvrda kopija biti prezentovana na konferenciji SIGGRAPH u julu.U videu koji služi kao demonstracija, žena izgovara "stotinu i devedeset jedan zarez četiri", a ovaj iskaz izmenjen je tako da zvuči kao da je rekla "stotinu i osamdeset dva zarez dva". A tu je i jedan čovek koji izgovara citat iz Apocalypse Now "Volim miris napalma ujutru", a ovaj citat pretvorili su u iskaz "Volim miris tosta ujtru."Kako bi uspeli u ovome, istraživači su identifikovali i izolovali foneme - malene jedinice zvuka u govoru [u srpskom jeziku, svaka fonema predstavljena je jednim slovom, što nije slučaj i u ostalim jezicima, među kojima je i engleski, prim.prev.] - koje su izgovorene u okviru datih fraza. Oni su takođe kreirali i 3D model lica i pratili kako se lice i usne kreću tokom izgovorenih reči. Onda, prinašli su vizeme - zvukove koji izgledaju isto, kada se radi o pokretima usana, kao što su "v" i "f" - i iskombinovali delove preuzete od modela lica kako bi se dobro uklopili sa novim frazama. Neko ko izgovori reč "viper" i nastavak "-ox" u različitim delovima videa može omogućiti da se seckanjem videa i uklapanjem u model lica izgovori reč "fox."A kako bi se učinilo da se izmenjeni glas poklapa sa ostatkom govora date osobe, istraživači su koristili VoCo, Adobov softver za menjanje glasa koji je ova kompanija plasirala 2016. Ako pažljivo posmatrate i znate šta treba da tražite (gotovo neprimetne krute pokrete usta, ili manje nekonzistentnosti u njihovom pokretanju) moći ćete da kažete gde su ubačene nove reči. Ipak, ukoliko ne znate da su se izmene dogodile, lako bi moglo da vam se desi da ih previdite.A kada govorimo o faktima nasuprot realnosti, ovo može biti najzapanjujućiji deo ove tehnike za obradu. U pitanju je mala promena, usta i vilica se izoluju i menjaju za samo nekoliko reči u okviru duže rečenice. U kontektu, vaše oči vide ono što žele da vide, popunjavajući praznine ili mutne delove tako da deluju razumljivo.Kako bi testirali koliko su ovi editovani snimci zapravo uverljivi, istraživači su sproveli onlajn istraživanje na 138 ispitanika, od kojih su tražili da gledaju pravi i editovan video, kao i da ih oba ocene u odnosu na iskaz "ovaj video snimak mi deluje realno" na skali od jedan do pet. Više od polovine ispitanika - oko šezdeset odsto - ocenili su oditovane snimke kao realne. Dok su needitovani, "istiniti" snimci ocenjeni kao realni u oko osamdeset odsto slučajeva.Još od početaka video snimaka na kojima se algoritamski menjaju lica, ili takozvanih "dipfejkova", koji su postali mejnstrim fenomen, počeli su da se oglašavaju alarmi koji govore o pitanju šta realistični, ali izmenjeni video snimci mogu učiniti konceptima istine i realnosti koji postoje u društvu. Malo istraživanje sprovedeno na korisnicima pokazalo je da su ove brige validne, kao i da su već deo naših života - kada je sve fejk, onda ništa nije realno.Ljudi se lako daju zavarati kada se radi o video snimcima koji potvrđuju ono u šta oni žele da veruju, kao što je slučaj bio sa editovanim videom Nensi Pelosi. Ipak, kada postoji upozorenje, stanje se menja, i primat preuzima kompletno nepoverenje prema tome da li je nešto zapravo stvarno.U svom radu, istraživači koji su radili na ovoj metodi zamene teksta posvetili su nekoliko podugačkih pasusa etničkoj raspravi o ovakvim tehnologijama. "Dostupnost ovakve tehnologije - u kavalitetu za koji mnogi smatraju da je nepromenjen u odnosu na izvorni materijal - takođe povećava važnost i validnost brige da se ove tehnologije potencijalno zloupotrebe", napisali su oni. "Mi smo svesni da loši glumci mogu koristiti ovakve tehnologije kako bi falsifikovali lične izjave ili ukaljali ugled nekih individua. Zabrinuti smo zbog potencijalne obanjivosti i mogućnosti zloupotrebe ove tehnologije."Oni su napisali da se nadaju da će iznošenjem ove metode na svetlost dana podići svest o mogućnostima koje ove tehnike za obradu video snimaka imaju kada se radi o tome da učine da ljudi budu skeptičniji prema onome što vide.Ovaj članak je prvobitno objavljen na VICE US.

Ako pažljivo posmatrate i znate šta treba da tražite (gotovo neprimetne krute pokrete usta, ili manje nekonzistentnosti u njihovom pokretanju) moći ćete da kažete gde su ubačene nove reči. Ipak, ukoliko ne znate da su se izmene dogodile, lako bi moglo da vam se desi da ih previdite.A kada govorimo o faktima nasuprot realnosti, ovo može biti najzapanjujućiji deo ove tehnike za obradu. U pitanju je mala promena, usta i vilica se izoluju i menjaju za samo nekoliko reči u okviru duže rečenice. U kontektu, vaše oči vide ono što žele da vide, popunjavajući praznine ili mutne delove tako da deluju razumljivo.Kako bi testirali koliko su ovi editovani snimci zapravo uverljivi, istraživači su sproveli onlajn istraživanje na 138 ispitanika, od kojih su tražili da gledaju pravi i editovan video, kao i da ih oba ocene u odnosu na iskaz "ovaj video snimak mi deluje realno" na skali od jedan do pet. Više od polovine ispitanika - oko šezdeset odsto - ocenili su oditovane snimke kao realne. Dok su needitovani, "istiniti" snimci ocenjeni kao realni u oko osamdeset odsto slučajeva.Još od početaka video snimaka na kojima se algoritamski menjaju lica, ili takozvanih "dipfejkova", koji su postali mejnstrim fenomen, počeli su da se oglašavaju alarmi koji govore o pitanju šta realistični, ali izmenjeni video snimci mogu učiniti konceptima istine i realnosti koji postoje u društvu. Malo istraživanje sprovedeno na korisnicima pokazalo je da su ove brige validne, kao i da su već deo naših života - kada je sve fejk, onda ništa nije realno.Ljudi se lako daju zavarati kada se radi o video snimcima koji potvrđuju ono u šta oni žele da veruju, kao što je slučaj bio sa editovanim videom Nensi Pelosi. Ipak, kada postoji upozorenje, stanje se menja, i primat preuzima kompletno nepoverenje prema tome da li je nešto zapravo stvarno.U svom radu, istraživači koji su radili na ovoj metodi zamene teksta posvetili su nekoliko podugačkih pasusa etničkoj raspravi o ovakvim tehnologijama. "Dostupnost ovakve tehnologije - u kavalitetu za koji mnogi smatraju da je nepromenjen u odnosu na izvorni materijal - takođe povećava važnost i validnost brige da se ove tehnologije potencijalno zloupotrebe", napisali su oni. "Mi smo svesni da loši glumci mogu koristiti ovakve tehnologije kako bi falsifikovali lične izjave ili ukaljali ugled nekih individua. Zabrinuti smo zbog potencijalne obanjivosti i mogućnosti zloupotrebe ove tehnologije."Oni su napisali da se nadaju da će iznošenjem ove metode na svetlost dana podići svest o mogućnostima koje ove tehnike za obradu video snimaka imaju kada se radi o tome da učine da ljudi budu skeptičniji prema onome što vide.Ovaj članak je prvobitno objavljen na VICE US.

Reklame

Reklame